O Problema com Ações Cegas

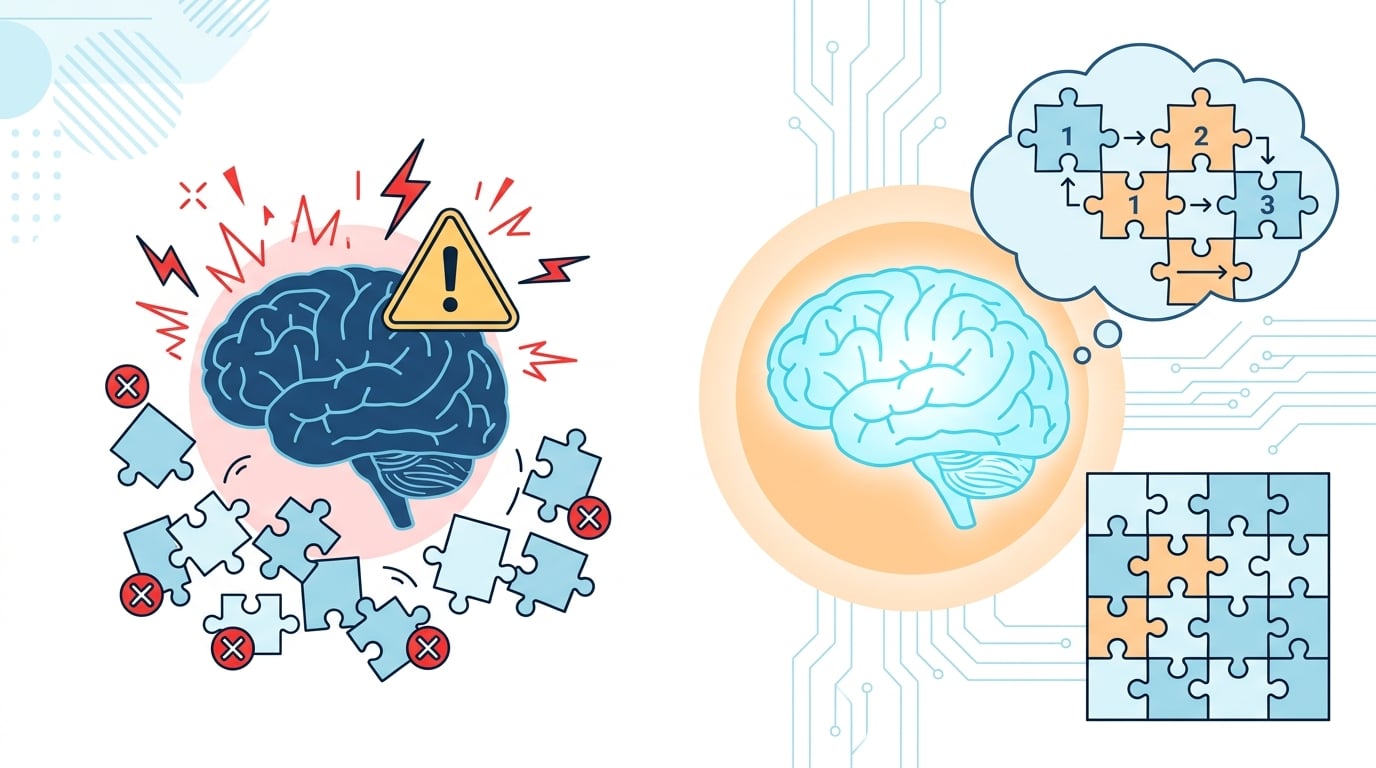

Ao resolver problemas lógicos complexos ou recuperar múltiplas informações, forçar uma IA a decidir imediatamente sobre uma Ação pode levar a erros desastrosos.

Pense em como um ser humano resolve um quebra-cabeça:

- Eles não pegam apenas uma peça aleatoriamente e a encaixam na placa.

- Eles mapeiam mentalmente ou verbalmente uma estratégia: "Primeiro, preciso encontrar as peças com borda plana para o contorno, depois ver se esta peça azul se encaixa."

Da mesma forma, se pedirmos a uma IA para apenas gerar uma Ação—ignorando a fase de raciocínio—ela está agindo "cegamente". Muitas vezes, ela vai adivinhar, alucinar ou escolher a ferramenta errada por completo, pois não mapeou os pré-requisitos necessários para responder à pergunta.

Pensar em Voz Alta

Modelos de linguagem constroem lógica token por token. Forçando a IA a "pensar em voz alta" (gerar texto analisando o problema) antes de selecionar uma ação, fornecemos o espaço necessário para chegar à conclusão lógica correta.